ИИ-агент «не шмог». Текущие пределы работы с документами

Вышел неплохой «рисеч» от ребят, которые специализируются на парсинге документов с помощью различных моделей: ParseBench. За супер подробностями можно обратиться уже к научной статье на arXiv.

Современные модели (VLM — Vision-Language Models) научились «видеть» документ и рассуждать об увиденном. Это важно, когда речь идет именно о сканированном документе, а не просто о текстовом слое, сохраненном в PDF.

Вердикт пока не очень позитивный, имхо. Хотя всё зависит, в буквальном смысле, от того, покупаете вы или продаете. Продавцов «ИИ-порошка» сейчас развелось достаточно.

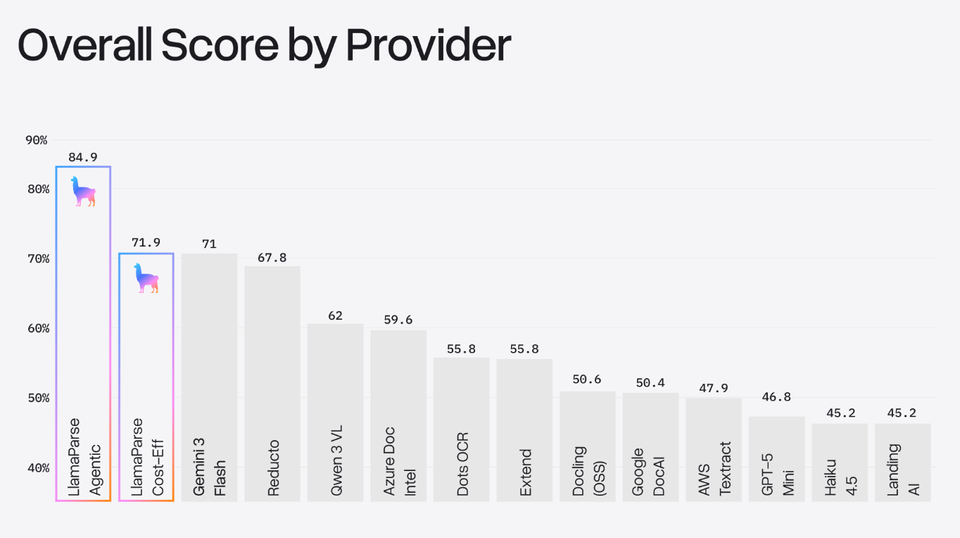

Я же смотрю на это как потенциальный потребитель. И агрегированный лучший результат в 84% выглядит не сильно вдохновляющим (см. скриншот к посту).

В целом, на каждые 10 страниц ИИ-агент допустит существенное искажение: неправильно распознает, выдумает факт или пропустит важное. Удивительно, что у Anthropic их модель Haiku в некоторых критически важных для агентных сценариев задачах — например, извлечение данных из диаграмм — давала результаты в районе 5–8%. Это не „совокупная точность", а именно отдельная метрика, где ошибка означает, что агент не смог проверить источник цифры или правильно интерпретировать таблицу. Доверять такому агенту финансовые документы опасно. Это немножечко приподнимает розовые очки и снижает градус восторга, что нечто может прям всё и без ошибок.

В связи с этим у меня недавно случился занятный казус именно с моделями Anthropic. Попробовал для личной задачи проанализировать обычный текстовый PDF. Вместо 13 млн руб. модель увидела 15 млн руб. и далее делала глубоко идущие выводы на основе этой ошибки.

Хорошо, что заметил. О чем и посетовал в одном чатике технарю, который, по ощущениям, не сильно примыкал к ИИ-хайпу, хотя и активно продает курсы обучения. На что получил ответ в стиле: «Сам дурак — ты просто не умеешь готовить ИИ-агента».

Разумеется, как готовить — не было даже намёка. И это тоже показательно: у людей прямой конфликт интересов. Если будешь рассказывать про наличие ошибок такого уровня, то тяжело продавать «будущее» и стимулировать FOMO у аудитории. А уж навешать лапшу гуманитариям — отдельный вид спорта сейчас.

Поэтому никаких ИИ в продакшене ;)

Комментарии